KORU股東

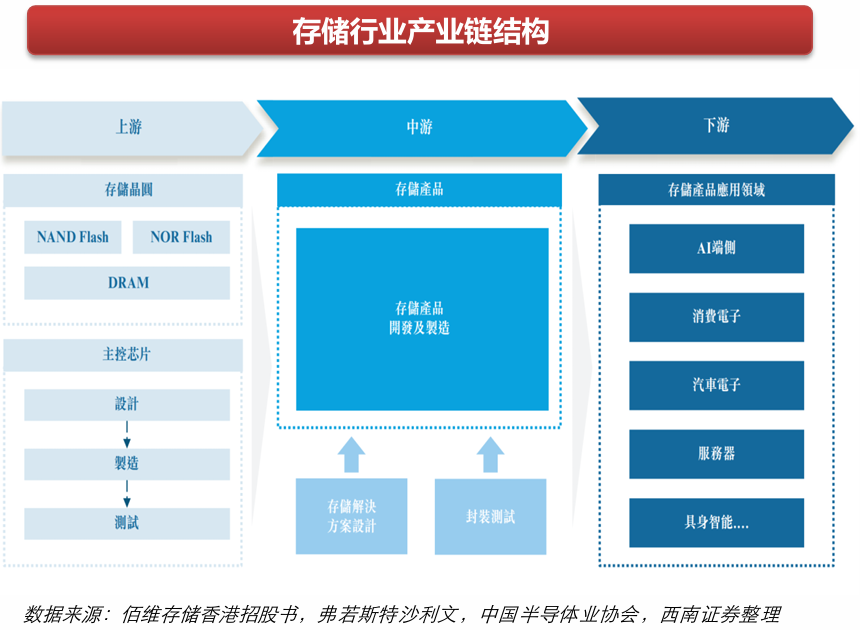

KORU股東內存在 AI 裏扮演的是"操作枱"角色,而且是卡脖子的那個環節。

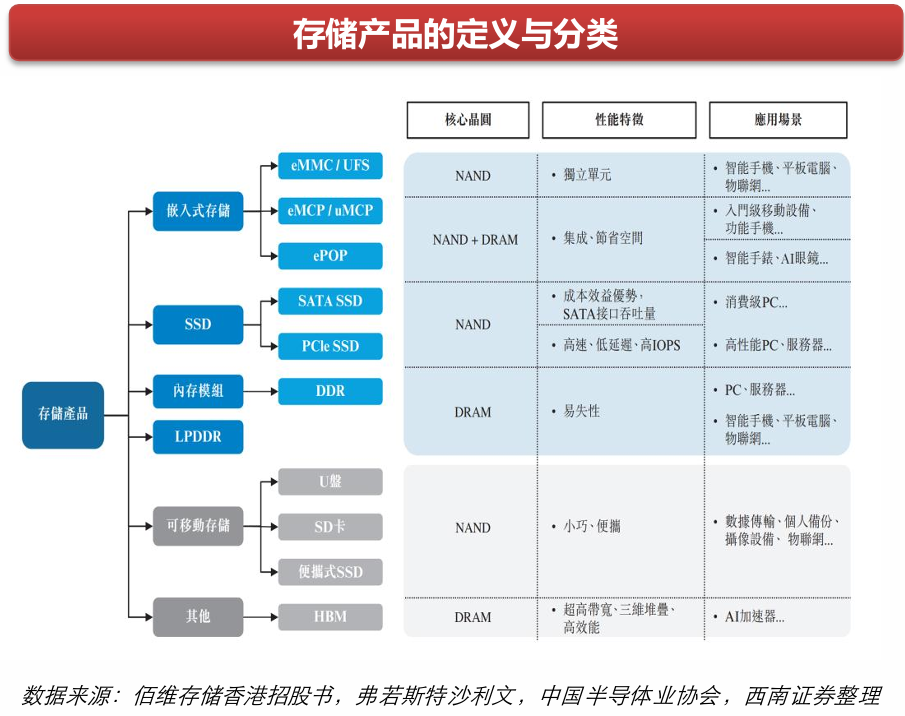

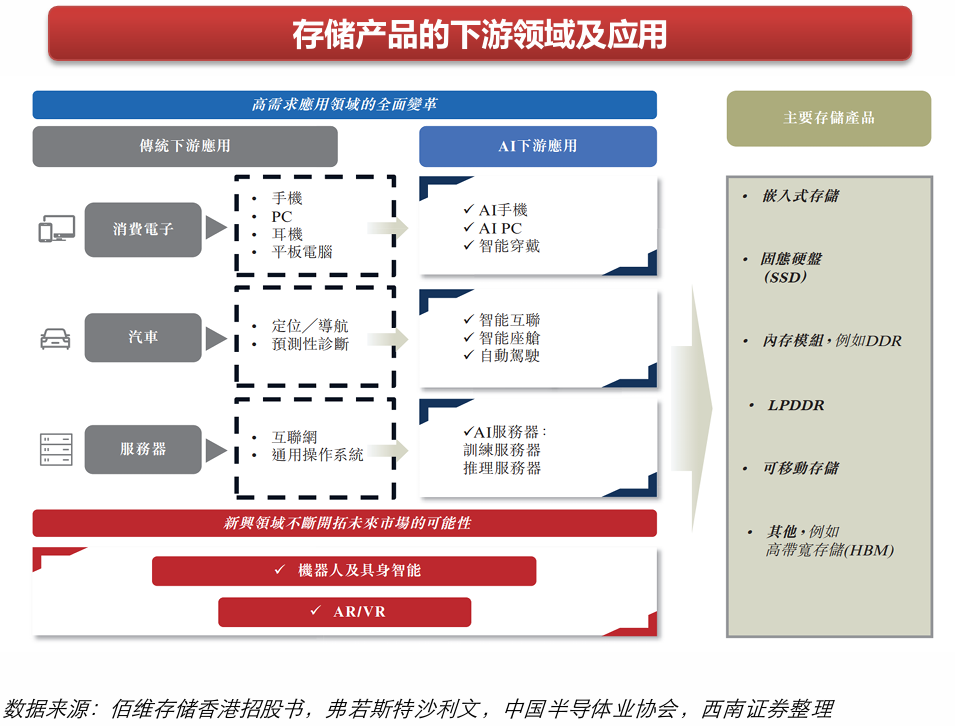

AI 訓練和推理的核心瓶頸不是算力不夠,而是數據餵給 GPU 的速度不夠快。GPU 算得極快,內存帶寬跟不上,GPU 就在那裏空轉等數據。這就是為什麼 HBM(高帶寬內存)會成為最緊俏的零件——它直接堆疊在 GPU 芯片上,帶寬比普通 DDR5 高出十倍以上。

一張 H100 裏有 80GB HBM,帶寬達 3.35TB/s。這個規格普通 DRAM 根本達不到,只有三星、SK 海力士、美光能生產,產能極度有限。

簡單説:SSD 決定你能存多少數據,內存決定 AI 能跑多快。後者直接卡住了 AI 性能的天花板。

本文版權歸屬原作者/機構所有。

當前內容僅代表作者觀點,與本平台立場無關。內容僅供投資者參考,亦不構成任何投資建議。如對本平台提供的內容服務有任何疑問或建議,請聯絡我們。