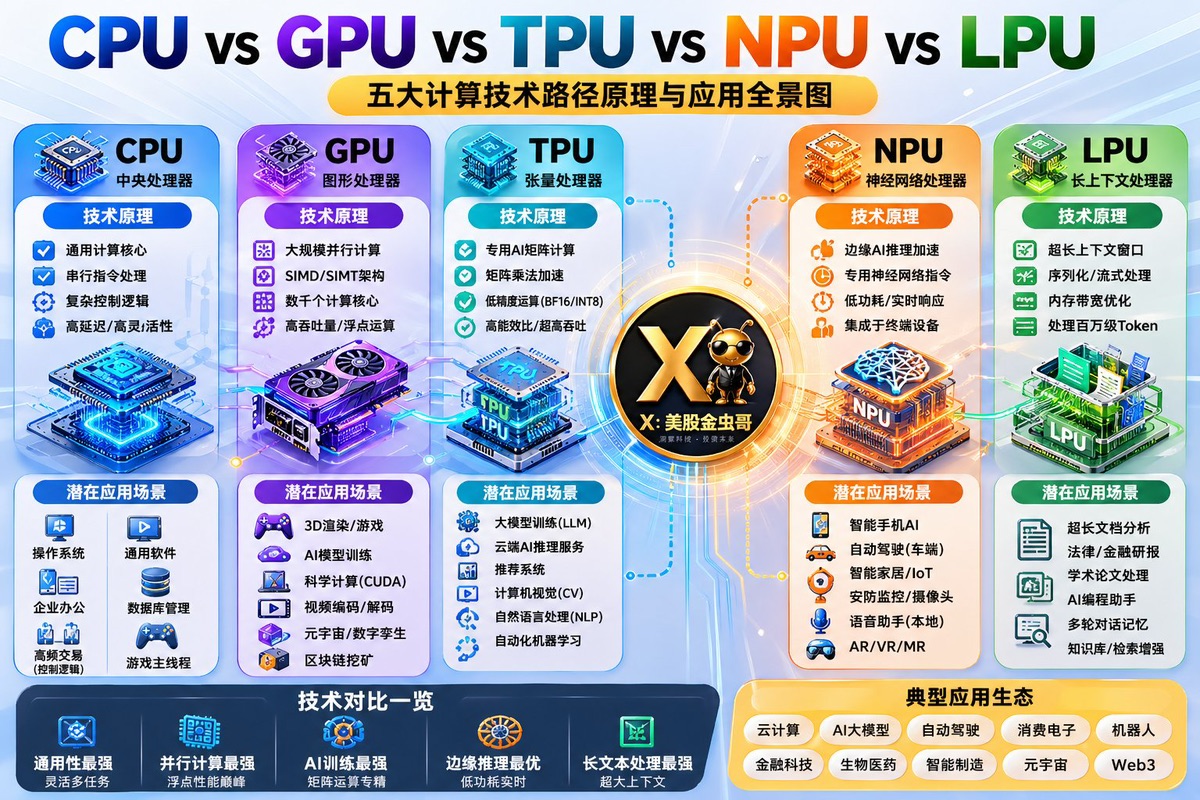

最近 AI 芯片的各种架构又被广泛讨论,CPU/GPU/TPU/NPU/LPU 各种技术路径又被大家拿出来广泛讨论

先说大背景:现在的 AI 已经从 “大规模训练” 转向 “大规模推理(inference)+ 智能体(agentic AI)+ 边缘计算(包括手机、汽车、工厂传感器、IoT 设备这些终端)”

训练阶段仍由 GPU/TPU 主导,但推理场景对低延迟、低功耗和成本更敏感;因此,边缘设备催生单瓦级功耗的 NPU,云端推理需要极致吞吐与确定性延迟,让 CPU、NPU 和 LPU 在各自细分领域重获优势

CPU 通用但慢;GPU 千核并行;TPU 脉动阵列专用;NPU 边缘低功耗(手机级);LPU 全 on-chip SRAM,零缓存延迟(但需多芯片互联)

整体市场仍处于爆炸式增长:AI 硬件市场 2024 年就接近 600 亿美元,2026 年仍在高速扩张,

核心是大家都在找 “比 GPU 更高效” 的替代路径

所以只要 AI 的 infra 还在大规模的建设:CPU/GPU/TPU/NPU/LPU 各种技术路径的龙头,大概率也还是有很大的增长空间的

#Google #Intel #Nvdia 都可以买点

本文版权归属原作者/机构所有。

当前内容仅代表作者观点,与本平台立场无关。内容仅供投资者参考,亦不构成任何投资建议。如对本平台提供的内容服务有任何疑问或建议,请联系我们。