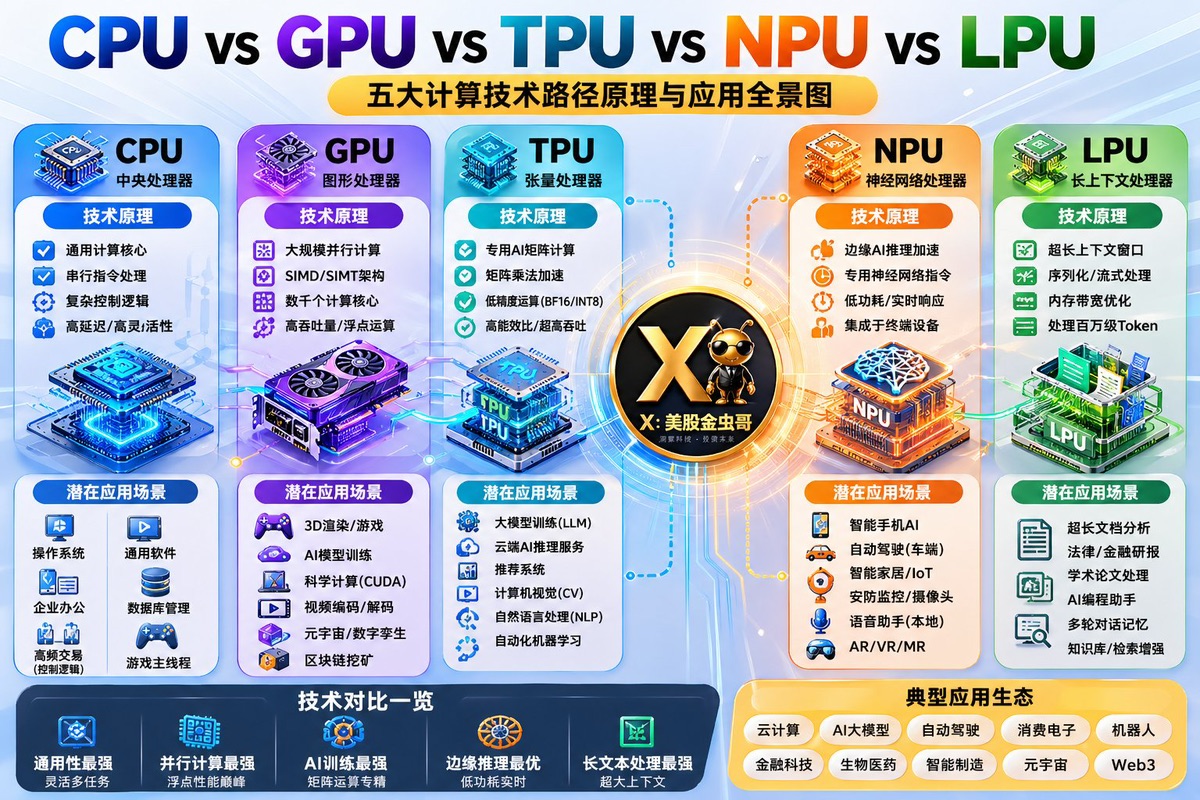

最近 AI 芯片的各種架構又被廣泛討論,CPU/GPU/TPU/NPU/LPU 各種技術路徑又被大家拿出來廣泛討論

先説大背景:現在的 AI 已經從 “大規模訓練” 轉向 “大規模推理(inference)+ 智能體(agentic AI)+ 邊緣計算(包括手機、汽車、工廠傳感器、IoT 設備這些終端)”

訓練階段仍由 GPU/TPU 主導,但推理場景對低延遲、低功耗和成本更敏感;因此,邊緣設備催生單瓦級功耗的 NPU,雲端推理需要極致吞吐與確定性延遲,讓 CPU、NPU 和 LPU 在各自細分領域重獲優勢

CPU 通用但慢;GPU 千核並行;TPU 脈動陣列專用;NPU 邊緣低功耗(手機級);LPU 全 on-chip SRAM,零緩存延遲(但需多芯片互聯)

整體市場仍處於爆炸式增長:AI 硬件市場 2024 年就接近 600 億美元,2026 年仍在高速擴張,

核心是大家都在找 “比 GPU 更高效” 的替代路徑

所以只要 AI 的 infra 還在大規模的建設:CPU/GPU/TPU/NPU/LPU 各種技術路徑的龍頭,大概率也還是有很大的增長空間的

#Google #Intel #Nvdia 都可以買點

本文版權歸屬原作者/機構所有。

當前內容僅代表作者觀點,與本平台立場無關。內容僅供投資者參考,亦不構成任何投資建議。如對本平台提供的內容服務有任何疑問或建議,請聯絡我們。